Das Fraunhofer-Institut für Integrierte Schaltungen begann Ende der 80er Jahre mit der Entwicklung eines Verfahrens zur Kompression von digitalen Audiodaten. Daraus entstand der standardisierte Algorithmus, der es möglich machte, die Datengröße von Audiomaterial zu reduzieren, ohne die Qualität erheblich leiden zu lassen und darüber hinaus auch in Echtzeit abspielen zu können.

In Anlehnung an die Entwicklungsgruppe MPEG wurde der Algorithmus MPEG-Audio bezeichnet.

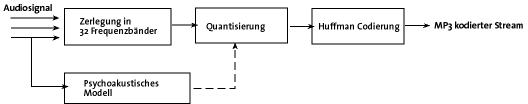

Das digitale Eingangssignal wird in ein Frequenzband mit 32 Teilen zerlegt. Dieser Vorgang wird als Zeit-Frequenzbereichs-Umsetzung bezeichnet. Dieses Prinzip entspricht dem Vorgang im menschlichen Gehör (Psychoakustisches Modell), wobei jene Töne berechnet werden, die von den meisten Hörern nicht mehr wahrgenommen werden.

Die MPEG-Kodierung nutzt eine Eigenschaft des Gehörs aus:

Von einer Menge an Tönen ähnlicher Frequenzen nehmen wir nur die Lauteren wahr, leise Töne werden überdeckt. Im Fachjargon spricht man von Maskierung.

Sowohl Quantisierung als auch Codierung beim MPEG-Verfahren erfolgen unter Berücksichtigung der Maskierungsschwelle.

Abb.: Schema MPEG-Audio Komprimierung

In Anlehnung an die Entwicklungsgruppe MPEG wurde der Algorithmus MPEG-Audio bezeichnet.

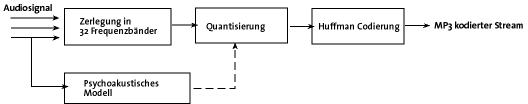

Das digitale Eingangssignal wird in ein Frequenzband mit 32 Teilen zerlegt. Dieser Vorgang wird als Zeit-Frequenzbereichs-Umsetzung bezeichnet. Dieses Prinzip entspricht dem Vorgang im menschlichen Gehör (Psychoakustisches Modell), wobei jene Töne berechnet werden, die von den meisten Hörern nicht mehr wahrgenommen werden.

Die MPEG-Kodierung nutzt eine Eigenschaft des Gehörs aus:

Von einer Menge an Tönen ähnlicher Frequenzen nehmen wir nur die Lauteren wahr, leise Töne werden überdeckt. Im Fachjargon spricht man von Maskierung.

Sowohl Quantisierung als auch Codierung beim MPEG-Verfahren erfolgen unter Berücksichtigung der Maskierungsschwelle.

Abb.: Schema MPEG-Audio Komprimierung

Verlauf

Verlauf

Alle Kapitel anzeigen

Alle Kapitel anzeigen